产品概况

通用入门级推理GPU

通用入门级推理GPU

NVIDIA A2 Tensor Core GPU 具有低功耗、小尺寸和高性能的特点,可为 NVIDIA 边缘 AI 提供入门级推理功能。A2 采用半高 PCIe 4.0设计和 40-60 瓦低热设计功耗(TDP)配置功能,为各种服务器带来自适应推理加速。

A2 的通用性、小尺寸和低功耗可轻松满足对大规模边缘部署的需求,能立即将现有的入门级 CPU服务器升级到能处理推理的水平。使用A2 GPU 加速的服务器提供比使用 CPU 更高的推理性能,智能视频分析(IVA)部署效率比使用前几代 GPU 更高,而且这都基于入门级价格。

A2 的通用性、小尺寸和低功耗可轻松满足对大规模边缘部署的需求,能立即将现有的入门级 CPU服务器升级到能处理推理的水平。使用A2 GPU 加速的服务器提供比使用 CPU 更高的推理性能,智能视频分析(IVA)部署效率比使用前几代 GPU 更高,而且这都基于入门级价格。

搭载 A2 GPU 和 NVIDIA AI 的 NVIDIA-Certified Systems(NVIDIA认证系统),包括 NVIDIA Triton 推理服务器,可跨边缘、数据中心和云提供突破性的推理性能。这些系统确保支持 AI 的应用能够以更少的服务器和更低的功耗完成部署,从而在显著降低成本的情况下更轻松地部署和更快地获取见解。

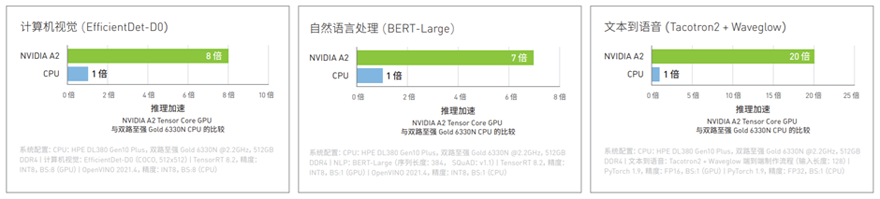

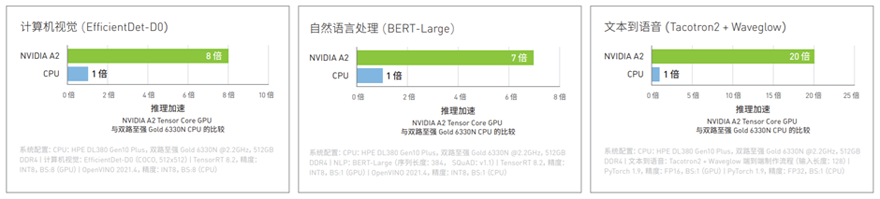

推理性能提升高达 20 倍

部署 AI 推理技术的目的是通过实时体验使消费者的生活变得更便利,并支持其从数万亿个端点传感器和摄像头获得认知。与 CPU 服务器相比,搭载 NVIDIA A2 Tensor Core GPU 的服务器可提供高达 20 倍的推理性能,能立即将服务器升级到能处理现代 AI 的水平。

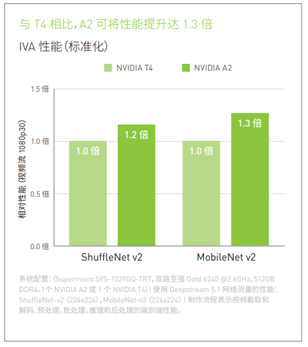

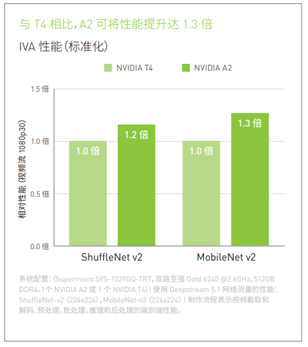

在智能边缘实现更高的 IVA 性能

在智慧城市、制造和零售等智能边缘用例中,搭载 A2 的服务器最高可将性能提升 1.3 倍。与前几代 GPU 相比,运行 IVA 工作负载的 NVIDIA A2 GPU 最高可将性价比和能效分别提升1.6 倍和 10%,从而改善部署效率。

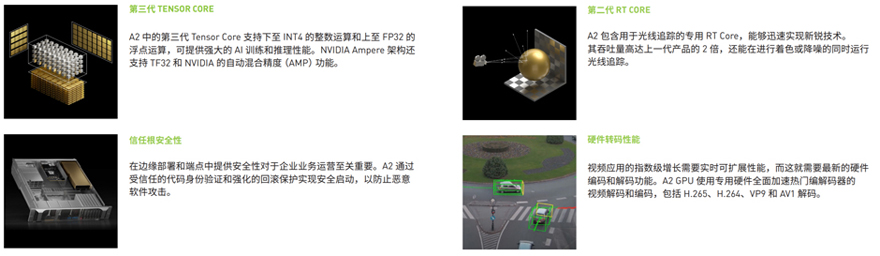

NVIDIA A2 带来突破性的 NVIDIA Ampere 架构创新

完整的推理产品组合

NVIDIA 提供完整的 NVIDIA 认证系统产品组合,搭载 Ampere Tensor Core GPU这一助力 NVIDIA AI 的推理引擎。A2 Tensor Core GPU 为已经包括 A100 和 A30 Tensor Core GPU 的 NVIDIA AI 产品组合增加了低版外形规格的入门级推理产品。A100 可实现各种规模的超高推理性能,A30 则为主流服务器提供更佳推理性能。NVIDIA A2、NVIDIA A30 和 NVIDIA A100 Tensor Core GPU 在边缘、数据中心和云中提供领先的推理性能。

适用于企业的优化软件和服务

NVIDIA AI Enterprise

NVIDIA AI Enterprise 是一套端到端云原生 AI 和数据分析软件,经认证可在基于服务器虚拟化平台的虚拟基础设施(带有 VMware vSphere)中的 A2 上运行。这使得在混合云环境中管理和扩展 AI 和推理工作负载成为可能。

系统规格

FP32 峰值性能

4.5 TF

4.5 TF

TF32 Tensor Core

9 TF | 18 TF1

9 TF | 18 TF1

BFLOAT16 Tensor Core

18 TF | 36 TF1

FP16 Tensor Core 峰值性能

18 TF | 36 TF1

INT8 Tensor Core 峰值性能

36 TOPS | 72 TOPS1

INT4 Tensor Core 峰值性能

72 TOPS | 144 TOPS1

RT Core 数量

10 个

10 个

媒体引擎

1 个视频编码器

1 个视频编码器

2 个视频解码器(包括 AV1 解码)

GPU 显存

16GB GDDR6

16GB GDDR6

GPU 显存带宽

200GB/s

200GB/s

互连

PCIe 4.0 x8

PCIe 4.0 x8

外形规格

单插槽,半高 PCIe

单插槽,半高 PCIe

最大热设计功耗(TDP)

40-60W(可配置)

vGPU 软件支持

NVIDIA 虚拟 PC (vPC)、

NVIDIA 虚拟 PC (vPC)、

NVIDIA 虚拟应用(vApp)、

NVIDIA RTX 虚拟工作站(vWS)、

NVIDIA AI Enterprise、

NVIDIA 虚拟计算服务器(vCS)

NVIDIA AI Enterprise、

NVIDIA 虚拟计算服务器(vCS)